AIによる意思決定を透明化するIBM Cloudサービスが登場:60%の企業がAIの責任問題を危惧

IBMは、AIのバイアスを検出し、AIがどのように意思決定を行ったかを説明可能なサービスの提供を開始した。AIに新たな透明性をもたらし、AIをより活用できるようになるという。研究者向けにオープンソースのツールも用意した。

IBMは2018年9月19日(米国時間)、企業のAI(人工知能)に新たな透明性をもたらし、AIをより活用できるようにする新しいソフトウェアサービスを発表した。「IBM Cloud」で実行し、IBMのサービス部門が活用支援サービスを提供する。

新しいサービスでは「Trust and Transparency(信頼性と透明性)」機能を提供する。AIによる意思決定について、自動的にAIのバイアスを検出し、AIがどのように意思決定を行ったかを説明するものだ。これにより、さまざまな業界の企業が自社でAIシステムを管理できるよう支援する。

Trust and Transparency機能を提供するIBMの新しいソフトウェアサービスを使うと、AIによる提案についてその理由が分かるようになる。どの因子がどの程度、提案を決定する際に影響したのかが分かり、提案の信頼度、信頼度の要因を表示できる(出典:IBM)

Trust and Transparency機能を提供するIBMの新しいソフトウェアサービスを使うと、AIによる提案についてその理由が分かるようになる。どの因子がどの程度、提案を決定する際に影響したのかが分かり、提案の信頼度、信頼度の要因を表示できる(出典:IBM)今回のサービスは、「Watson」「TensorFlow」「Spark ML」「AWS SageMaker」「Microsoft Azure Machine Learning」など、多種多様な機械学習フレームワークとAI構築環境で構築されたモデルに対応する。つまり、企業が使用する一般的なAIフレームワークの大半に、新サービスを活用できる。

加えて、任意のビジネスワークフローの特異な決定因子を監視するようプログラミングでき、組織における特定の用途にカスタマイズできる。

今回のサービスは完全に自動化されており、実行時、つまりAIが意思決定を行うタイミングで意思決定の説明とAIモデル内のバイアス検出を行い、不公平な結果が起こる可能性を特定する。さらに、検出したバイアスを軽減できるように、モデルに追加すべきデータを自動的に提案する。

サービスの説明では分かりやすい用語を用いており、どの因子がどの方向でどの程度、意思決定に影響したのかを示す。AIの提案の信頼度、信頼度の要因も分かる。さらに顧客サービスやGDPR(EU一般データ保護規則)の順守などの規制や法令順守上の理由がある場合は、モデルの精度や性能、公平性、AIシステムの影響の記録を、簡単にさかのぼって呼び出すことができる。

これらの機能は全て視覚的なダッシュボードからアクセスでき、AIが導き出した決定の理解、説明、管理を行う能力をビジネスユーザーに提供するとともに、専門的なAIスキルへの依存を低減する。

IBMは、企業が意思決定におけるバイアスの影響を最小化するビジネスプロセスや、人とAIのインタフェースを設計できるよう支援する新しいコンサルティングサービスも併せて提供する。

研究者向けのオープンソースツールも提供

サービスの発表と併せて、IBM ResearchがAIバイアスの検出と軽減を目的としたツールキット「AI Fairness 360」をオープンソースコミュニティーに提供することも明らかにした。AIバイアスへの対処に関するグローバルコラボレーションを推進するとしている。

同ツールキットは新規開発されたアルゴリズムやコード、チュートリアルから成るライブラリだ。学者や研究者、データサイエンティストに対して、機械学習モデルの構築と導入を行う際にバイアス検出を組み込むためのツールと知識を提供する。IBMによれば他のオープンソースリソースは学習データ内のバイアス確認を重視しているが、AI Fairness 360は、AIモデル内のバイアス確認と軽減に役立つという。

企業はAI活用に危惧を感じている

これらの新たな取り組みは、IBMビジネス・バリュー・インスティテュート(IBM Institute for Business Value)による最新の調査を踏まえて進められている。この調査では、82%の企業がAI導入を検討しているものの、60%は責任問題を危惧しており、63%はAIを確実に管理するための人材が社内にいないことが明らかになった。

IBMのWatson AI担当ゼネラルマネジャーを務めるベス・スミス氏は、次のように説明している。

「IBMは、新たなAI技術を開発するためのTrust and Transparencyの原則の確立において業界をリードする。われわれはこの原則を実践に移し、AIが誤った意思決定を行うリスクを抱える企業に、新たな透明性と対策を提供する」

関連記事

TensorFlowを使った機械学習を論文抽出に適用、ヒントは大学入試問題対策の裏ワザ

TensorFlowを使った機械学習を論文抽出に適用、ヒントは大学入試問題対策の裏ワザ

医師が、ディープラーニングフレームワークのTensorFlowを自ら用い、診療ガイドラインの作成における「心の折れる作業」である論文スクリーニング作業を自動化。効果を実証した。ヒントは共通一次試験の対策本にあった。 IBMとIDC Japanが語るワークスタイル変革の現在と未来とは

IBMとIDC Japanが語るワークスタイル変革の現在と未来とは

日本アイ・ビー・エムは2016年7月27日、東京・お茶の水のソラシティカンファレンスセンターで『「IBM Connect Japan 2016」〜新しい働き方へ導く「次の一手」』を開催。IDC Japanによる基調講演が行われた。 AIには「信頼」が必要――Microsoft、AIの開発・活用で重視すべき「6つの倫理的要件」を発表

AIには「信頼」が必要――Microsoft、AIの開発・活用で重視すべき「6つの倫理的要件」を発表

Microsoftが、AIの開発と活用で重視すべき「6つの倫理的要件」を発表。急速に開発が進むAIは、一方で信頼と倫理に関する複雑な問題を提起すると指摘。その疑念を払拭し、人間がAIの恩恵を最大限に享受するには「6つの倫理的要件」が重要だとしている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

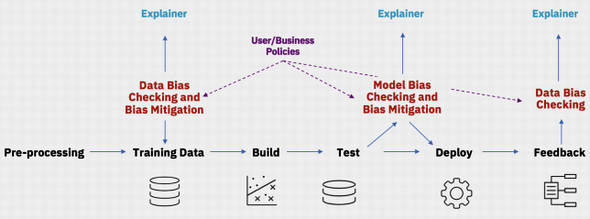

AI Fairness 360はAIのライフサイクル全体にわたってバイアスを緩和できる(

AI Fairness 360はAIのライフサイクル全体にわたってバイアスを緩和できる(