空前絶後のAI、VR、IoT、そしてYouTube! 全ての技術を使ったマッシュアップの産みの親! 超絶怒涛のMA2016決勝戦!!:エンジニアを愛し、エンジニアに愛されたイベント!(2/3 ページ)

「アイデア」「完成度」「デザイン」で全てのエンジニアが競う「For All」コース11作品

引き続き「For All」コースのファイナルステージ進出作品を見ていこう。

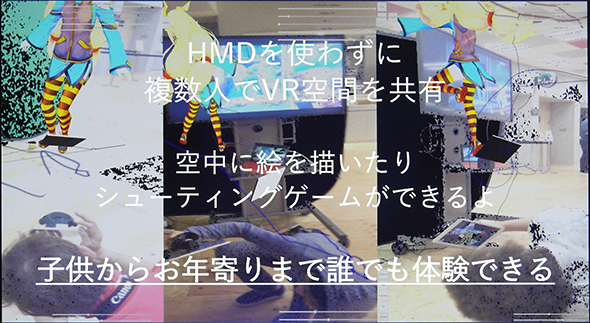

VISTouch AIR

2015年のMashup Awardsにおいて「参式電子弓」で最優秀賞に輝いたチームが、2016年もファイナルステージに進出。今回の出品作である「VISTouch AIR」は、ヘッドマウントディスプレイ(HMD)のような大掛かりな装置を必要とせず、「iPad Air」を使ってVR/ARの世界をのぞき込めるという作品だ。

2016年は「HTC Vive」「Oculus Rift」「PlayStation VR」といったコンシューマー向けVR機器が続々と発売され「VR元年」などとも呼ばれた。しかし、これらのHMD型VR機器には「重い」「不特定多数の人で共有すると不衛生」「別途高スペックなPCやゲーム機へのケーブル接続が必要で取り回しが不便」「健康上の問題から12歳以下の子どもによる利用が推奨されない」などといった、複数の解決すべき課題があるというのが「VISTouch AIR」の開発契機となっている。

仮想空間をのぞき込むための「窓」としてタブレットを利用することで、これらの課題は解決できるという。また、グリーンバックを用意することで現実世界と仮想空間を重ねたAR的な利用もでき、ゲームのようなエンターテインメント分野だけでなく、3Dのレントゲン画像を医師や患者で共有するような実用にも発展できそうなアイデアだ。

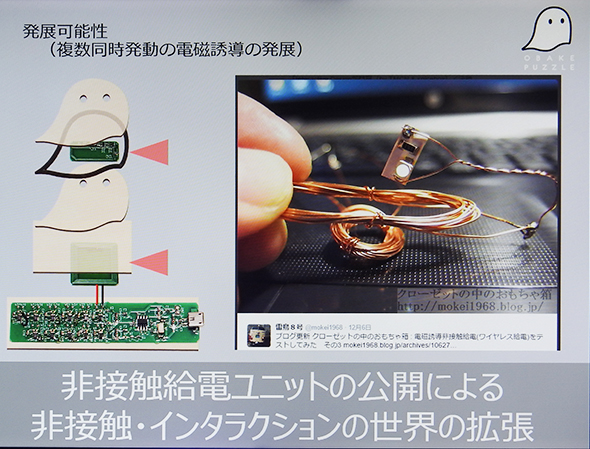

おばけパズル

暖かみのある木製のピースを使った「おばけパズル」は、ピースの中にひっそりと仕込まれた非接触給電回路とLEDが遊ぶ人に「不思議さ」を感じさせる作品だ。

内容は、おばけの形をしたピースを、台の上の正しい位置にはめ込んでいくという至ってシンプルなパズルなのだが、ピースが正しい位置に置かれたときにおばけの「目」が光るようになっているところがポイントだ。電子回路は完全にピースの中に隠されてしまっており、接点やコードなども外側からは見えない。見た目には、全く「電気っぽさ」を感じさせない作りでありながら、突然控えめな「光」でのインタラクションが起こるところに予想外の驚きと面白さがある。

今のところ、この「おばけパズル」の制作は、1台当たり30時間近くをかけて調整を行いながら、手作りしているという。開発チームでは、この非接触給電の技術を使って、光だけでなく音や振動などを取り入れた作品の開発なども検討しているとする。

Freedom Foodmaker(FFVR)

最初に言っておくべきことがあるとすれば、この「Freedom Foodmaker」は「おばかアプリ部門賞」を受賞した作品である。それを頭の片隅に置いて、以下の説明文を読んでほしい。内容がよく分からない人も多いと思うが、特に気にする必要はない。実際、現場でプレゼンテーションを見ていた筆者も、よく分かっていないからだ。

本当かどうかは試したことがないのだが「プリンに“しょうゆ”をかけて食べるとウニの味がする」らしい。「Freedom Foodmaker」では、VR的な技術で視覚や触覚、さらに聴覚や感情を刺激して、この「プリン+しょうゆ=ウニ」の現実感を最大限に増幅してくれる。頭部に装着したHMDでは、ネット上にアップされた新鮮なウニ画像が視界を埋め尽くし、耳元では「ぐるなびAPI」から取得した臨場感あふれるレビュー文が音声合成で読み上げられる。さらに、オプションの「フィードバックフォーク」により、スプーンですくい上げたプリン……いや、ウニが補食を恐れて逃げ出そうとする動きもフィードバックする。

もう少し続ける。さらに、ウニの味の記憶を「泣けるほど感動的なもの」にするために「走馬燈エンジン“Nirvana”」を開発。プリン……いや、ウニを飲み込もうとする瞬間に、捕食者は捕食される側のウニの「記憶」を映像として鑑賞し、自らにインストールできるようになっている。らしい。

発表者「……というわけで、これはプリンというより、完全なウニです。さらに、ウニの記憶をユーザーにインストールすることで、引きこもりが旅に出たくなるところまでを演出し、海に向かって叫びたくなる状況を……」

審査員「えーと、ちょっと、何言ってるのかよく分かんないです。きっと、ちゃんとしたプレゼンもできるチームだと思うんで、ちゃんとやってください」

なんとかめーかーりある

brick*blockが開発した「なんとかめーかーりある」は、木製のボードにブロックを置くことで、2D横スクロールアクションゲームの画面をコンストラクションできる作品。ゲーム画面は、ピクセルキャラクターが登場する「スーパーマリ●」へのオマージュ感あふれるものなのだが、実際にボード上に置いたブロックが、画面へ即座に反映されるところに新鮮な驚きがある。

ボードには、画面上のステージ構成に対応した60個のマスがあり、その裏に60個のCDS(照度センサー)が取り付けられている。各CDSが検知する明るさから、上にブロックが置かれているかどうかを判別しているという。なお「なんとかめーかーりある」では、ブロックの置き手側とプレイヤーキャラクター側に分かれて対戦が可能なゲームモードも実装されている。ブロックが置かれてから一定時間内に、そのブロックにタッチできるかどうかでスコアを競うというルールだ。

プレゼンテーションでは、審査員が実際にボードとPCを使って対戦ゲームを行った。リアルなUIとコンピュータゲームを結び付ける試みが面白い作品だ。今後は、プレイヤー操作のコントローラー対応や、CDSによる照度だけでなく、ブロックの距離や色を検知できるような仕組みなども組み込んでみたいと考えているという。

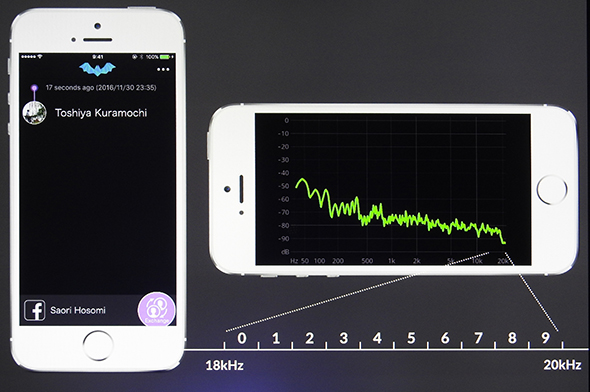

Hz(ヘルツ)

勉強会や飲み会など、多くの人が集まる場で、他の参加者と「SNSのアカウント」を交換した経験がある人も多いのではないだろうか。方法としては「相手にアカウント名を教えて検索してもらう」「QRコードを出して、相手側のスマホアプリで読み取ってもらう」「LINEふるふるやBUMPのような専用アプリを使う」など、さまざまなものが考えられるが、いずれも「1人ずつとしか交換できない」「操作に手間が掛かる」「精度が低い」といった問題がある。

「Hz(ヘルツ)」は、作者が独自に開発した「音」(不可聴域の超音波)による通信プロトコルを使い、3〜5メートルまでの範囲内でHzを立ち上げている複数人の中で、一斉にFacebookアカウントを交換するアプリになっている。音が拾えるマイクがついたものであれば、端末を選ばず、ペアリングなども行わずに、一斉に情報が交換できる点がメリットだとする。

音を利用する通信手段ということで、審査員からは「雑音が多いところでは精度が落ちるのではないか」という質問があったが、利用しているのは高周波なため、あまり周囲の雑音に影響を受けず、かつ複数回の通信でエラー訂正なども考慮しているため問題は少ないだろうとのことだ。既にApp Storeで公開されているアプリなので、関心がある人はぜひ試してみてほしい。

MagicKnock with MagicTV

テレビ、HDDレコーダー、ミニコンポ、照明、エアコンなどなど、家の中で操作すべき「リモコンの数が多過ぎる」問題には、多くの人が頭を悩ませてきたはずだ。「MagicKnock with MagicTV」は、テーブルの上に置くだけで、あらゆるものを「ノック」で操作できるようにするデバイスである。

本体となる「MagicKnock」は小さい灰皿程度のサイズで作られた円筒形デバイス。これをテーブルやコタツの上に置き、天板を「コンコン」とノックすると、圧電素子が振動を検知して信号に変換する。ノックの強弱やパターンを認識でき、「MagicTV」アプリケーションと連携することで、特定の電子機器の動作を制御できるようになっている。操作したい機器に対するノックのパターンを覚えておけば、決まった動作をするだけでコントロールが可能だ。

また、メニューの選択内容を音声でフィードバックする仕組みも実装されているので、慣れるまでは音声を聞きながら実行内容を確認することもできる。

MagicKnockデバイスについては小型化が可能なため、キッチンにある冷蔵庫や部屋の壁などに取り付けて、それぞれに対応する機器を操作できるようにするといった展開も考えられるという。

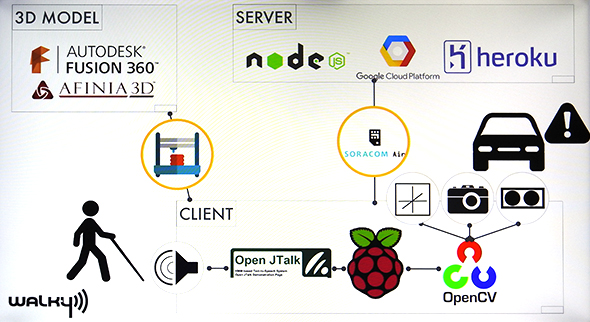

Walky

東工大メディア研究会による「Walky」は、視覚障がい者が外出時に利用する「白杖」の障害物検知機能をテクノロジーの力で大幅に強化したものである。開発メンバーの目が不自由な親族から「白杖を使うと、足元にある障害物を検出できるが、違法駐車の車やトラック、自転車など、出っ張りや高さのあるものが分からず、外出時に恐怖を感じる」と聞いたことが開発のきっかけになったという。

進行方向の障害物を検知できる「超音波センサー付き白杖」は、既に商品化されているものの「常に反応しっぱなしで、具体的に何があるのか分からない」という問題があり、決して使い勝手の良いものではないという。そこで「Walky」では、超音波センサーとカメラを組み合わせて利用することにした。

前方の様子をカメラで撮影し、その画像に写っているものをGoogle Cloud Vision APIで自動認識。障害物が具体的に「何」であり、それが「どのくらい」先にあるかを音声でリアルタイムにユーザーへ通知する。通知には指向性スピーカーを利用し、聴覚から得る情報が多い視覚障がい者がイヤフォンなどで耳をふさぐことなく、かつ利用者にだけ音声が聞こえるようにすることで、場所にとらわれずに使えるような工夫も施されている。

開発者は今後の課題として、常に持ち歩くデバイスとしての軽量化と長時間駆動の両立を挙げている。

ディスレクシアの人のための字幕読み上げ機能付きYouTubeプレイヤー

日本では「難読症」「識字症」とも呼ばれる「ディスレクシア」は、文字の読み取りに困難が伴う障がいを持つ人のこと。日本においては、学習障がいの4.5%がディスレクシアに該当するのではないかとの報告もあるという。開発者のゆきまる氏は、ディスレクシア保護者の会へのヒアリングから、YouTubeで配信されている海外動画の「字幕」に着目。画面に表示される字幕を読むことが難しい人に向けて、それを自動で読み上げるシステムを開発した。

使い方を分かりやすくするため、プログラムはブラウザのブックマークレット形式で提供される。対象となるYouTube動画を表示した状態でブックマークレットをクリックすると、YouTube APIから字幕情報を取得し、その内容をWeb Speech APIで読み上げる。

スライドバーによる読み上げスピードの調節や、声の高低の変更などにも対応する。ポイントとしては、YouTubeの字幕翻訳に対応したあらゆる言語に適用できる点、ブラウザが動作すればPCだけでなくスマートデバイスなどでも使える点などを挙げた。開発者は、実際に9人のディスレクシアの子どもたちに、このプレーヤーを使って動画を視聴してもらい、字幕の読み上げがあることで内容の理解度が増すことを確認したという。

ディスレクシアは文字を読むことが困難な以外に特に生活上の問題がなく、その部分のサポートさえあれば通常の生活を送ることができるケースが大半だという。開発者は「ディスレクシアにも、テキストベースのコンテンツをもっと楽しみたいと思っている人が多い。このアイデアを育てていけば、社会的にもより良いプロダクトが生み出せると思う」と語った。

トイレの神様

チーム烏枢沙摩(ウスサマ)による作品「トイレの神様」は「トイレ」のIoT化に真正面から取り組んだ作品である。トイレは、誰もが毎日利用する設備であるにも関わらず、プライバシー上の問題などから「見守り」のための仕組みを取り入れることが難しかったと開発者は指摘する。

この作品は、便座型のセンサーデバイスと、そこから取得した情報をベースにユーザーサポートを行うサービス部分から構成されている。便座デバイスでは、人によってそれぞれ異なる便座への「座り方」(重さや重心の位置など)から、座っている人が家族の誰なのかを機械学習で識別できる仕組みを実装。これにより「トイレログの最大の課題であった“これ、誰やねん”問題をついに解決した」(開発者)とする。

さらに、便座デバイスで取得した情報から、蓋を開けたままで個室を出ようとする人を注意したり、長時間着座していたら話しかけたりといった機能も搭載。オプションデバイスのマイクを使うと、トイレの中での会話内容をもとに感情分析を行い、ユーザーの精神的なサポート(?)も行えるという。

「IoT」を「Internet of Toilet」の略とするなど、一見、ネタ的な要素が多い作品だが、トイレへの着座だけで個人を判別できる仕組みは、介護施設における利用者の見守り用途などへの応用も期待できそうだ。

srt.js:YouTubeの映像と連動したMashup作品を簡単に作れるJavaScriptフレームワーク

2015年は「Openness-adjustable Headset」、2014年は「Tetris 3D Modeler」でファイナルステージに連続出場し、「ミスターMashup Awards」として名をはせる栗原一貴氏の最新作は「srt.js」と名付けられたJavaScriptフレームワークである。

「Mashup Awardsが好き過ぎて、ついにマッシュアップを簡単に行うための仕組みそのものを作った」という同作は、YouTubeの字幕エディタ内にJavaScriptを記述することで、映像コンテンツを拡張するものだ。もともとハッカソン向けに作ったAPI群ということで、YouTubeの動画プレーヤーを軸に、他のスマートデバイスやIoT機器などとの連携が容易に行えるものになっている。センサーデバイスなどの入力情報をトリガーにして動画の再生制御を行ったり、動画の内容に同期して外部のデバイスを動作させたりなど、さまざまな形での利用が可能だ。

デモとしては、「PCのカメラデバイスと連動してユーザーが画面を見ている間だけ動画を再生し、離席時には一時停止する」「MESHのスイッチを使い、花火の打ち上げと連動して動画を再生する」「面白い映像を子どもに見せながら、PC内蔵カメラで笑顔の写真を撮る」「PPAPの動画と連動して、再生デバイスを踊らせる」など、同フレームワークのさまざまな応用例が示された。おおよそJavaScriptでできることは、全てできてしまうようである。

審査員からも指摘された同作品の最大の問題点は「セキュリティ」だ。これについては、栗原氏自身も「基本的にXSSで、何でも実行できてしまうので現状のままではダメ」だと認識しているという。これについては、何らかの形で認証されたスクリプトのみを動かすといった形での対応策が考えられるとしている。

どこでもMステ

「以前、ギターをやっていて、ずっとMステに出たいと思っていた」という作者による「どこでもMステ」は、あらゆる場所で「Mステ」の入場シーンを再現できるという作品。カーペットの上を歩くと、自動的にLEDが点灯し、“あのオープニング曲”がスタート。手を振れば沸き上がる歓声。キリが良いところでタイミングに合わせてオープニング曲を締めるという一連の流れを1人で完結できてしまう。

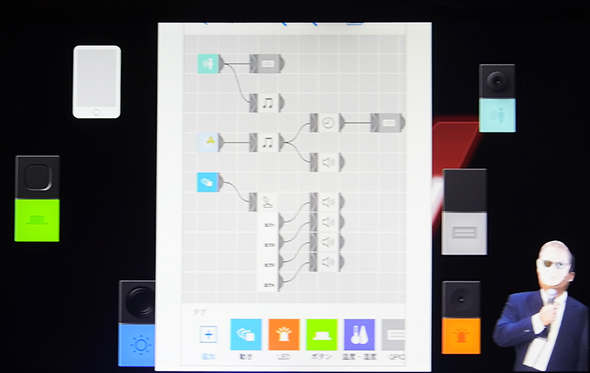

技術的には「MESH」をフル活用しており、オープニング曲のトリガーには人感センサーの「Motion」、歓声のトリガーには手に装着した「Move」、曲の締めには照度センサーの「Brightness」が、それぞれ使われている。コードを書かずにプログラミングできる環境が整ってきている中、あえて全体をMESHのノンコーディング環境でマッシュアップすることにこだわったという。

プレゼンには、Mステ司会者ふうの扮装をしたグラサンのサポーターも登場し「For All」コース作品発表の締めくくりを大いに盛り上げていた。

関連記事

マッシュアップもIoTへ――「下手な芸人より面白い」「狂気を感じる」「絶句した」な12作品が集まった #MA11 決勝戦まとめ

マッシュアップもIoTへ――「下手な芸人より面白い」「狂気を感じる」「絶句した」な12作品が集まった #MA11 決勝戦まとめ

全国の開発者が、自らの技術力と、世の中に公開されているさまざまなAPI、ハードウエア、センサーなどを「マッシュアップ」して、新たな作品を作り出すコンテスト「Mashup Awards」(MA)が今年も開催。同コンテストの最優秀作を決定する最終プレゼンテーション「ファイナルステージ」と、各賞の発表が、11月18日に東京の渋谷ヒカリエで行われた。 技術とアイデアのカオスから生まれた未知の可能性を感じるアプリ15連発〜MA10決勝戦まとめ

技術とアイデアのカオスから生まれた未知の可能性を感じるアプリ15連発〜MA10決勝戦まとめ

毎年恒例となった「Mashup Awards」の決勝戦と授賞式が、2014年11月19日に渋谷ヒカリエホールで開催された。ファイナリスト15組によって行われた最終プレゼンの様子と、受賞作品を紹介する。 「その発想はなかった」が12連発! アプリ・Webサービス・ものづくり・おばかの最先端がここにある〜MA9決勝戦レポート

「その発想はなかった」が12連発! アプリ・Webサービス・ものづくり・おばかの最先端がここにある〜MA9決勝戦レポート

450以上の応募作品の中から最終プレゼンに残った12作品を紹介する。最優秀賞は誰の手に? おばかアプリ賞を勝ち取ったAndroidアプリの開発秘話の独占インタビューも。

Copyright © ITmedia, Inc. All Rights Reserved.