セキュリティ担当者は「AIを業務に安全に導入するための知識や認識が組織に足りない」と感じている ISC2:過半数が「AIでより価値の高い仕事に時間を割ける」と回答

ISC2は、AIがサイバーセキュリティ人材に与える影響について調査した結果を発表した。同社は「AIの専門知識とAIを活用した脅威の可能性に対処するための準備状況の間に格差が広がっていることが明らかになった」としている。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

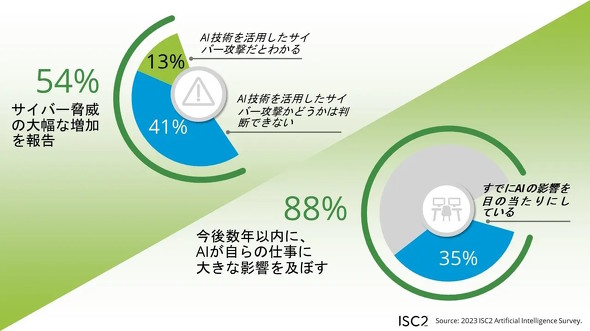

ISC2は2024年2月27日、「AI in Cyber 2024:Is the Cybersecurity Profession Ready?」を公開した。これは、AI(人工知能)がサイバーセキュリティ人材に与える影響について調査した結果をまとめたもの。それによると、回答者の88%が、「今後数年以内に、AIが自らの仕事に大きな影響を及ぼす」と答え、その内35%が「すでにAIの影響を目の当たりにしている」と回答した。

なお、調査は世界のサイバーセキュリティ業務に関わるISC2の会員を対象に実施し、1123人から有効回答を得た。

「自組織がAIに関する方針を策定している」は27%

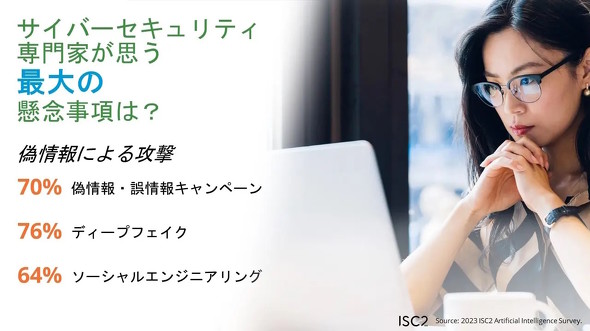

調査結果によると「AIが業務効率を向上させる」と回答した人の割合は82%。「今後一部の業務がAIに取って代わられ、より価値の高い仕事に時間を割けるようになる」と回答した人は56%だった。AIがサイバー攻撃や悪意ある活動に利用されることについて75%が「懸念がある」(やや懸念がある、非常に懸念している)と回答した。AIに関する懸念(脅威)としては「ディープフェイク」(76%)、「偽情報、誤情報キャンペーン」(70%)、「ソーシャルエンジニアリング」(64%)などが挙がった。

AIの導入について不安を覚える声もある。「自組織におけるAIの導入を、自信を持って実施できる能力がある」と回答した人の割合は60%、AIや機械学習(ML)に関する専門知識が「ほとんどない」または「全くない」と回答した人は41%だった。

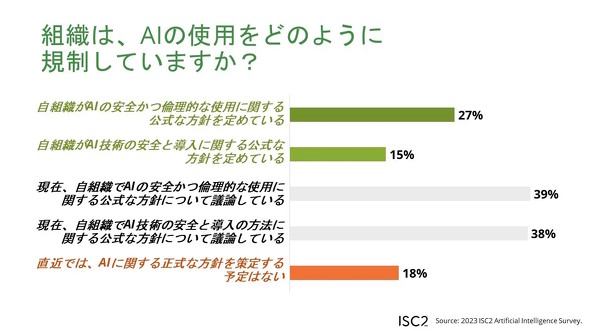

82%の人が「AIの安全かつ倫理的な使用を規定する、包括的かつ具体的な規制の必要性を感じている」と回答。しかし、「自組織がAIの安全かつ倫理的な使用に関する公式な方針を策定している」と回答した人はわずか27%だった。また、39%は「現在、自組織で公式な方針について議論のさなか」と回答した。

ISC2のCEOを務めるクレア・ロッソ氏は、「サイバーセキュリティの専門家たちは、AIがチャンスと課題の両方をもたらすと予測しており、AIを業務に安全に導入するための専門知識や認識が組織に不足していることを懸念している。このような状況は、サイバーセキュリティの専門家たちが、安全な技術に関する専門知識を応用し、AIの安全で倫理的な使用を保証することで、AI導入の取り組みを主導する絶好の機会を生み出す」と述べている。

関連記事

【動画あり】サイバーセキュリティ人材が欲しい! に応える無料の電子書籍

【動画あり】サイバーセキュリティ人材が欲しい! に応える無料の電子書籍

人気連載を電子書籍化して無料ダウンロード提供する@IT eBookシリーズ。第115弾は連載「セキュリティ人材育成を考える」全4回を電子書籍化しました。IT人材の不足が叫ばれている昨今、中でもセキュリティ人材は貴重な存在です。本eBookではセキュリティ人材を確保するアプローチとその育成ノウハウを解説します。 「プロンプトインジェクション」「ジェイルブレイク」など5項目を診断 生成AI診断サービスをラックが提供開始

「プロンプトインジェクション」「ジェイルブレイク」など5項目を診断 生成AI診断サービスをラックが提供開始

ラックは、生成AIシステムのセキュリティを強化するサービス「生成AI活用システム リスク診断」の提供を開始した。生成AIを使ったシステムに特有の脆弱性が含まれていないかどうかを評価し、改善点をレポートする。 「ハードに」ではなく「スマートに」仕事をしていきたい

「ハードに」ではなく「スマートに」仕事をしていきたい

グローバルに活躍するエンジニアを紹介する本連載。今回もNTTデータ ニューソンのセキュリティ担当、Alicia Lee(アリシア・リ)さんにお話を伺う。アリシアさんが実感したという「複数の言語を操れること」の最も大きなメリットとは何か。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.