インテル、Spark対応の分散型ディープラーニングライブラリ「BigDL」をオープンソース化:GitHubで公開

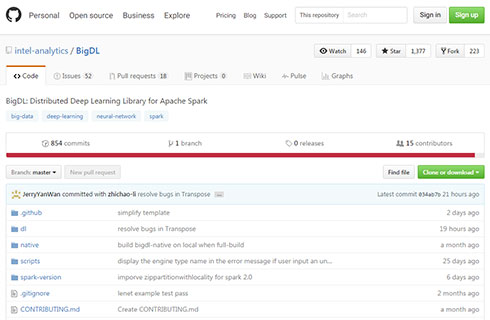

インテルがデータサイエンティストのディープラーニング活用を支援する「Apache Spark」対応分散型ディープラーニングライブラリ「BigDL」をオープンソース化。GitHubで公開した。

米インテルは2017年2月8日(米国時間)、クラスタコンピューティングフレームワーク「Apache Spark(以下、Apark)」に対応する分散型ディープラーニングライブラリ「BigDL」をオープンソース化し、GitHubで公開したと発表した。

BigDLの提供は、業界最先端のAI(Artificial Intelligence:人工知能)の実現を支援する同社が進める戦略の一環という。インテルは2016年11月に発表したこの戦略に基づき、BigDL以外にも、Intel Nervana AI Academyを通じてAI関連のトレーニングやツールを開発者に広く提供している。

BigDLは、Sparkアーキテクチャ上に構築する分散型ディープラーニングライブラリ。高度なビッグデータ分析を行うデータサイエンティストなどに向け、ディープラーニングの活用を容易にするという。

BigDLは、データの保存、処理とマイニング、フィーチャーエンジニアリング(特徴量設計)、機械学習とディープラーニングワークロードのための統合型データ分析プラットフォームとしても機能する。BigDLにより、ユーザーは標準的なSparkプログラムとしてディープラーニングアプリケーションを作成し、既存のSparkまたはHadoopクラスタ上で実行可能。ディープラーニングワークロードで使用するデータを直接操作できるよう配置することが可能だ。BigDLは既に「Databricks Spark Platform」で稼働している。

インテルはBigDLの特徴として以下の3つを挙げている。

高度なディープラーニング展開のサポート

BigDLはディープラーニングライブラリである「Torch」をモデルにしており、Tensorによる数値計算や高次ニューラルネットワークを含むディープラーニングを包括的にサポートする。ユーザーはBigDLを使って、訓練済みのTorchか「Caffe」のモデルをSparkプログラムにロードできる。

高いパフォーマンス

高いパフォーマンスを実現するために、BigDLは「Intel MKL(Math Kernel Library)」とマルチスレッドプログラミングを各Sparkタスクで使用している。オープンソースのディープラーニングライブラリである「Caffe」「Torch」「TensorFlow」をシングルノードのXeon環境での一般的な設定で使用する場合と比べて高速に動作するという。

効率的なスケールアウト

BigDLは、Spark上での同期SGD(Stochastic Gradient Descent:確率的勾配降下法)の効率的な実装と通信の大幅削減が可能。ビッグデータスケールのデータ分析ができるように効率的にスケールアウトできる。

具体的には、BigDLは以下のようなシーンで効果的だという。

- データの保存場所(HDFS、HBase、Hiveなど)と同じビッグデータ(Hadoop、Spark)クラスタ上で膨大なデータを分析する場合

- ディープラーニング機能(訓練または予測)をSparkプログラムやワークフローに追加する場合

- 既存のHadoop/Sparkクラスタを利用してディープラーニングアプリケーションを実行し、複数のワークロード(ETL、データウェアハウス、フィーチャーエンジニアリング、従来の機械学習、グラフ分析など)で動的に共有されるように構築する場合

関連記事

Sparkは“誰”に例えられる?──多様化と進化を続ける「Hadoop」、人気急上昇「Spark」

Sparkは“誰”に例えられる?──多様化と進化を続ける「Hadoop」、人気急上昇「Spark」

先日、日本Hadoopユーザー会主催のイベントが開催されました。データベースと関係性が深いデータ分散処理プラットフォームである「Hadoop」と「Spark」の最近事情に迫ります。 ニューラルネットワーク、Deep Learning、Convolutional Neural Netの基礎知識と活用例、主なDeep Learningフレームワーク6選

ニューラルネットワーク、Deep Learning、Convolutional Neural Netの基礎知識と活用例、主なDeep Learningフレームワーク6選

最近注目を浴びることが多くなった「Deep Learning」と、それを用いた画像に関する施策周りの実装・事例について、リクルートグループにおける実際の開発経験を基に解説していく連載。初回は、ニューラルネットワーク、Deep Learning、Convolutional Neural Netの基礎知識と活用例、主なDeep Learningフレームワーク6選を紹介する。 Apache Sparkとは何か――使い方や基礎知識を徹底解説

Apache Sparkとは何か――使い方や基礎知識を徹底解説

本連載では、Sparkの概要や、ローカル環境でのSparkのクラスタの構築、Sparkの基本的な概念やプログラミングの方法を説明していきます。 Apache Sparkに注力するIBM、目指すは「データ分析のOS」

Apache Sparkに注力するIBM、目指すは「データ分析のOS」

北米トヨタ販売子会社での採用事例の発表などもあり、日本国内でも注目を集めつつある「Apache Spark」。具体的にはどんな特徴があって、何ができるのだろうか。Sparkへの大規模投資を発表したIBM(日本IBM)を取材した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.