LAION-5B:オープンで大規模なマルチモーダル(画像+テキストのペア)データセット:AI・機械学習のデータセット辞典

データセット「LAION-5B」について説明。約58億5000万個のカラー画像データとテキストのペアのデータセットが無料でダウンロードでき、テキストから画像を生成する大規模なマルチモーダルAIの研究開発などに利用できる。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

データセット解説

LAION-5Bは、約58億5000万個の大規模なCLIP(=テキストと画像をつなぐ技術)処理が施された「カラー画像」と「テキスト」のペアのデータセットである(図1)。このデータセットは画像生成AI「Stable Diffusion」の学習で用いられていることで有名である。ちなみに、CLIPについてはStable Diffusionの記事でも簡単に説明している。

LAIONとは、大規模な機械学習モデルやデータセット、それに関連するコードを一般公開することを目的として、世界中からメンバーが参加する非営利団体である。本稿で紹介したデータセット以外にもさまざまなプロジェクトがある。ちなみに、LAIONは「ライオン」(動物のライオンのつづりは「LION」)と読むようである。

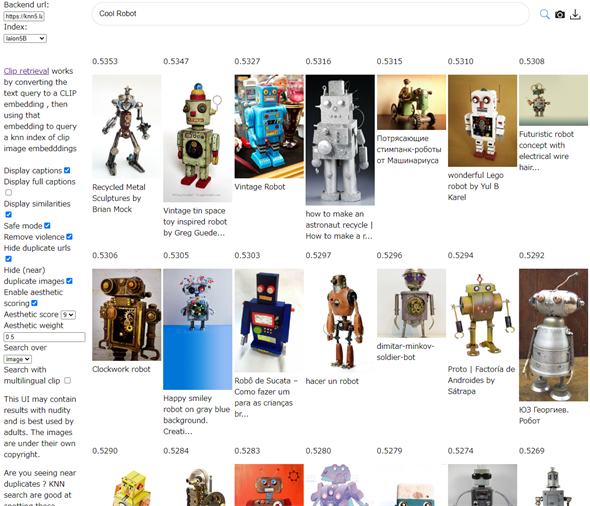

約58億と非常に膨大なデータセットであるが、LAION-5Bのデータ検索デモが提供されているので、簡単にどのようなデータがあるかは確認できる。図1は、実際に検索デモを試した例だ。

用途

LAION-5Bの目的は、大規模なマルチモーダル(=画像とテキストなど複数種類)のデータセットを使った機械学習の研究と実験を「民主化(=誰でもできるように)」することとされている。よって、研究目的で使用することが推奨されている。製品の作成で使用することは(執筆時の2023年1月12日時点では)非推奨とされている。

LAION-5Bは、CLIP技術(CLIP ViT-L/14埋め込み表現)を用いる大規模なAIの研究開発で使えるだろう。例えばStable Diffusionのように、テキストから画像を生成できるAIなどを研究開発したいときに使うとよい。

LAION-5Bプロジェクトでは、下記の3つのパッケージがリリースされている。全て合計すると約58億5000万個となる。

- laion2B-en: データセットのうち約23億2000万個には、英語のテキストが含まれている

- laion2B-multi: 約22億6000万個には、英語以外の10以上の言語のテキストが含まれている

- laion1B-nolang: 約12億7000万個には、特定の言語を明確に検出できなかったテキストがある

LAION-5BのライセンスはCC-BY 4.0となっており、クレジット表示のみなのでほとんど制限がない。

利用方法

LAION-5Bデータセットをダウンロードするには、img2datasetというPythonパッケージを用いると快適とのことである。

このデータセットを用いて機械学習の訓練を行う際には、「訓練のためのユーザーガイド」を参照することが推奨されている。

その他、データセットの列項目などの詳細は公式ページを確認してほしい。

注意

2023年12月20日ごろに、スタンフォード大学の研究により、LAION-5Bデータセット内に児童ポルノ画像(CSAM:Child Sexual Abuse Material)が含まれている可能性が指摘されました。LAIONはこれに対し、違法コンテンツの排除に取り組んでいるとの声明を発表しています。この問題に関して詳しくは、スタンフォード大学の論文とLAIONの公式声明をご確認ください。

ここを更新しました(2024年7月24日)

CSAM(児童ポルノ画像)についての言及を注意として書き加えました。

Copyright© Digital Advantage Corp. All Rights Reserved.