「AI」「機械学習」「ディープラーニング」は、それぞれ何が違うのか:「ニューラルネットワーク」とは何か

「AI」「機械学習」「ディープラーニング」は、それぞれ何が違うのか。GPUコンピューティングを推進するNVIDIAが、これらの違いを背景および技術的要素で解説した。

米NVIDIAは2016年7月29日、公式ブログでテクノロジージャーナリストであるマイケル・コープランド氏による記事「人工知能、機械学習、ディープラーニングの違いとは」を公開した。今後のビジネスを変革すると期待される技術の1つとして、「AI(Artificial Intelligence:人工知能)」が注目を集めている。このAIは、「機械学習」や「ディープラーニング」とともに取り上げられることが多いことから、この3つの単語の意味や背景を整理して解説したものだ。以下、ブログ記事を抄訳する。

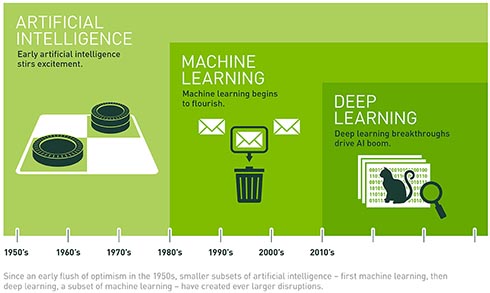

AI、機械学習、ディープラーニングの関係は、「同心円的に表す」と理解が進む。最初に生まれた、最も包括的な概念がAI。次に発展した機械学習がその中に含まれ、最後に登場したディープラーニングがさらにその中に含まれる構図だ。

AIの概念や単語は、1956年に米ダートマス大学で開催された会議で確立したとされる。以後、盛り上がりそうで冷めていく波が繰り返されてきたが、ここ数年、特に2015年以降より急速な盛り上がりを示している。その大きな理由は、速く、比較的安価に、強力な並列処理を実現できる「GPU(Graphics Processing Unit)コンピューティング」の普及、そして「実質的に無限にスケールアウトできるストレージ技術」と、「イメージ、テキスト、トランザクション、マッピングデータなど、あらゆる種類の膨大なデータと、そうしたビッグデータシステム全体の動き」の3つの重要な要素が同時期に登場したことが関係している。

AI研究の草創期には、人間のあらゆる感覚と、あらゆる判断力を備え、人間と同じように考えられる「汎用AI(General AI)」の構想が描かれた。しかし、現時点で実現されているのは、特定のタスクを人間と同等、またはそれ以上の処理速度でこなす「特化型AI(Narrow AI)」となる。特化型AIの例としては、米ピンタレストの画像分類や、米フェイスブックなどでの顔認識といったものが挙げられる。これらの技術は、人間の知能の「特定の側面」を再現するもので、それを可能にするために利用されているのが機械学習である。

機械学習とは、世の中の特定の事象についてデータを解析し、その結果から傾向を学習して、判断や予測を行うためのアルゴリズムを使う手法。「大量のデータとタスクを実行する方法を学習する能力」を提供するアルゴリズムによって、マシンの訓練が行われる。こうしたアルゴリズムによるアプローチに、決定木学習、帰納論理プログラミング、クラスタリング、強化学習、ベイジアンネットワークなどの手法が取り入れられたが、いずれも初期段階では、汎用AIはもとより、特化型AIにも思うように適用できなかったという。

そこで、この他の手法として登場したのがディープラーニング技術となる。ディープラーニングを支えるアルゴリズムのアプローチが「ニューラルネットワーク」だ。ニューラルネットワークは、人間の脳の生物学的な仕組み(ニューロン間のあらゆる相互接続)から着想を得たものだ。

ニューラルネットワークは極めて高い計算処理性能を要することが課題だったが、前述したGPUコンピューティングなどの技術的進歩を背景に、2016年現在、それが可能になった。ニューラルネットワークを大幅に拡大し、「層」と「ニューロン」を増やして、膨大なデータをシステムで処理する。こうした多層構造のニューラルネットワーク(ディープニューラルネットワーク)を使った機械学習がディープラーニングと呼ばれるようになった。

2016年現在、ディープラーニングを利用して訓練されたシステムによる画像認識性能が、人間の能力を超えるまでになっている。それは、猫の識別から、MRIスキャン画像を用いたがんの兆候の発見まで、多岐にわたる。また、米グーグルのAI部門 DeepMindが開発した「AlphaGo(アルファ碁)」は、囲碁の「強さ」を高めるべく、自身との対局を何度も繰り返して自己的に訓練し、そのニューラルネットワークを最適化した。

ディープラーニングによって、機械学習、そしてAI分野の実用的応用が数多く実現するだろう。ディープラーニングが今後もAIに明るい未来をもたらすと記事では予想している。

関連記事

ニューラルネットワーク、Deep Learning、Convolutional Neural Netの基礎知識と活用例、主なDeep Learningフレームワーク6選

ニューラルネットワーク、Deep Learning、Convolutional Neural Netの基礎知識と活用例、主なDeep Learningフレームワーク6選

最近注目を浴びることが多くなった「Deep Learning」と、それを用いた画像に関する施策周りの実装・事例について、リクルートグループにおける実際の開発経験を基に解説していく連載。初回は、ニューラルネットワーク、Deep Learning、Convolutional Neural Netの基礎知識と活用例、主なDeep Learningフレームワーク6選を紹介する。 個人と対話するボットの裏側――大衆化するITの出口とバックエンド

個人と対話するボットの裏側――大衆化するITの出口とバックエンド

マシンラーニング、ディープラーニングなど、未来を感じさせる数理モデルを使ったコンピューター実装が注目されている。自ら学習し、機械だけでなく人間との対話も可能な技術だ。では、コンピューターはどのように人間との対話を図ればよいのだろうか。コンピューターの技術だけでなく、そこで実装されるべきインターフェースデザインを考えるヒントを、あるコンシューマーアプリ開発のストーリーから見ていく。 Azure MLって何? からワークスペース作成まで

Azure MLって何? からワークスペース作成まで

数学的な知識やソフトウェア知識がないと挑戦しにくい印象の機械学習を、Webサービスとして利用できる環境が「Azure Machine Learning」です。全体のプロセスを見ながら体験して理解してみましょう。 ビジネスアナリティクス、機械学習の進化とSASの新アーキテクチャ

ビジネスアナリティクス、機械学習の進化とSASの新アーキテクチャ

統計解析、予測分析でリーダー的存在の米SASが、同社製品群の大部分を新アーキテクチャに移行すると、2016年4月に発表した。これを、ビジネスアナリティクスの世界全般における動向との関連で探る。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.