基盤モデル(Foundation Model)とは?:AI・機械学習の用語辞典

用語「基盤モデル」について説明。大量のラベルなしデータを使って事前学習し、その後、幅広い下流タスクに適応できるようにファインチューニングする、という2段階の訓練工程を踏んだ、1つのAI・機械学習モデルのことを指す。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

用語解説

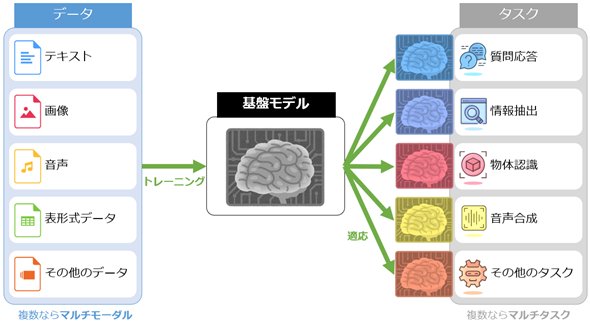

基盤モデル(Foundation Model:ファウンデーションモデル、ファンデーションモデル)とは、大量のデータを用いてトレーニング(事前学習)したAI・機械学習モデルのことである。このトレーニングは、一般的に正解ラベルのないデータを使用した自己教師あり学習で行われる。その後、基盤モデルは、幅広い下流タスクに適応できるように再トレーニング(主にファインチューニング)される。この2段階の訓練工程が特徴であり、1つの基盤モデルで多様なタスクに適応できること(マルチタスク能力)が大きな特徴だ(図1)。

基盤モデルは、2021年にスタンフォード大学のHAI(人間中心のAI研究所)によって広められた用語で、2022年中に特にAI関連の研究者や技術者の間で徐々に脚光を浴びるようになった。OpenAIが発表したGPT-3や、同じくOpenAIが開発したCLIP(例えば「Stable Diffusion」の中でも使われている)などが、その代表例である。2023年にはGPT-4が登場するなど、基盤モデルは依然として進化を続けており、多様な分野での応用が進んでいる。

基盤モデルは今後、マルチタスク性だけでなくマルチモーダル性をさらに高めて発展していく可能性が高い。テキスト/画像/音声/表形式データなど多様なデータ(=モダリティー)から事前学習する場合は、マルチモーダル基盤モデル(Multimodal Foundation Model)とも表現される。例えば2022年には、DeepMindが汎用(はんよう)型の人工知能としてGatoを発表しており、これは「マルチモーダル基盤モデル」と呼べるだろう。2023年には、例えばテキストだけでなく画像も事前学習した「GPT-4V(ision)」のようなモデルが登場するなど、複数のモダリティーを統合した形での応用が進んでいる。

ここを更新しました(2023年12月4日)

基盤モデルの定義をより分かりやすく修正しました。GPT-4やGPT-4Vなどの最新状況を書き加えました。

Copyright© Digital Advantage Corp. All Rights Reserved.